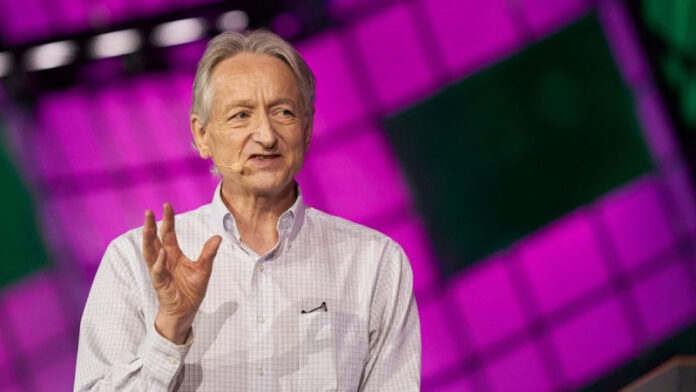

Ведущий специалист в области разработки искусственного интеллекта предупреждает, что ИИ развил рудиментарную способность рассуждать и может попытаться свергнуть человечество. По словам Джеффри Хинтона, профессора информатики из Университета Торонто, у систем искусственного интеллекта может появиться желание перехватить контроль у человека для достижения других запрограммированных целей. «Я думаю, мы должны серьёзно относиться к возможности того, что если они станут более умными, что возможно, и у них появятся собственные цели, они вполне могут развить цель захвата контроля, — сказал Хинтон во время выступления 28 июня на технологической конференции Collision в Торонто, Канада. — Если они это сделают, у нас будут проблемы». Хинтона называют одним из «крёстных отцов ИИ» за его работу в области нейронных сетей. Он провёл десятилетие, помогая разрабатывать системы ИИ для Google, но в прошлом месяце покинул компанию, заявив, что ему необходимо иметь возможность предупреждать людей о рисках, связанных с ИИ. Хотя Хинтон не считает, что ИИ по своей природе жаждет власти, тем не менее он может попытаться отобрать её у людей в качестве логичного шага, чтобы лучше достигать своих целей. «На самом общем уровне, если у вас есть умное ИИ, оно уже умеет очень хорошо манипулировать людьми, то на самом общем уровне, уверены ли вы, что люди останутся у руля?» ¬— сказал Хинтон. «Я думаю, что они будут использовать мотив захвата контроля как способ достижения других целей». Ранее Хинтон сомневался, что в ближайшие 30–50 лет появится сверхразумный ИИ, который мог бы сравниться с человеком. Теперь он считает, что это может произойти менее чем за 20 лет. Отчасти, по его словам, это связано с тем, что системы ИИ, использующие большие языковые модели, начинают демонстрировать способность рассуждать, и он не может с уверенностью объяснить, как они это делают. «Именно большие языковые модели приближаются к этому, и я не очень понимаю, почему они могут это делать, но они могут делать небольшие умозаключения. Они всё ещё не могут сравниться с нами, но они приближаются к этому». Хинтон рассказал о системе искусственного интеллекта, которой была дана головоломка, где она должна была спланировать, как покрасить несколько комнат в доме. Ей дали три цвета на выбор, причём один цвет со временем переходил в другой, и попросили покрасить определённое количество комнат в определённый цвет в заданное время. Вместо того чтобы просто покрасить комнаты в нужный цвет, ИИ решил не красить те, что, как он знал, всё равно выцветут до нужного цвета, решив сэкономить ресурсы, хотя он не был запрограммирован на это. «Это и есть мышление», — сказал Хинтон. В связи с этим Хинтон сказал, что нет причин полагать, что в ближайшие годы ИИ не достигнет и не превзойдёт человеческий интеллект. «Мы просто большая нейронная сеть, и нет причин, по которым искусственная нейронная сеть не сможет делать всё то, что можем делать мы», — сказал Хинтон. «Мы вступаем в период огромной неопределённости. Никто толком не знает, что произойдёт». Программа искусственного интеллекта ChatGPT, которая генерирует человекоподобные разговоры, на ноутбуке 3 февраля 2023 года. (Nicolas Maeterlinck/Belga Mag/AFP via Getty Images) Однако ИИ, возможно, даже не нужно достигать сверх интеллекта, чтобы представлять экзистенциальную опасность для человечества. По словам Хинтона, военные по всему миру создают военных роботов с искусственным интеллектом, которые могут либо попытаться взять управление на себя для выполнения своих запрограммированных задач, либо нарушить политический порядок, стимулируя рост конфликтов. «Смертоносное автономное оружие заслуживает того, чтобы о нём много думали», — сказал Хинтон. «Даже если ИИ не будет сверхинтеллектуальным, если оборонные ведомства будут использовать его для создания боевых роботов, это будет очень неприятная и страшная вещь». Среди стран, стремящихся разработать смертоносный ИИ, лидируют две крупнейшие военные державы мира — Китай и США. Коммунистический режим Китая разрабатывает смертоносные системы с поддержкой ИИ и инвестирует в возможности ИИ, связанные с принятием военных решений и командованием и управлением. США тем временем готовятся к миру, в котором национальные армии будут состоять в основном из роботов, что, по прогнозам высшего командования, произойдёт менее чем через 15 лет. «Мы знаем, что они собираются создать боевых роботов, — сказал Хинтон. — Они заняты этим во многих различных оборонных ведомствах. Так что роботы необязательно будут хорошими, поскольку их главная цель — убивать людей». Более того, Хинтон считает, что создание смертоносных автономных систем с поддержкой ИИ кардинально изменит структуру геополитики, резко снизив политические и человеческие издержки войны для тех стран, которые могут позволить себе такие системы. «Даже если это не сверхинтеллект, и даже если у него нет собственных намерений.… Это значительно облегчит, например, богатым странам вторжение в бедные страны», — сказал Хинтон. «В настоящее время существует препятствие для произвольного вторжения в бедные страны, которое заключается в том, что домой возвращают погибших. Если это просто мёртвые боевые роботы, то это просто замечательно. Военно-промышленному комплексу это понравится». В связи с этим Хинтон считает, что правительствам следует попытаться стимулировать проведение дополнительных исследований, направленных на защиту человечества от ИИ. Проще говоря, сказал он, многие люди работают над улучшением ИИ, но очень немногие делают его безопасным. Ещё лучше, по его словам, было бы установить международные правила для запрета или регулирования систем оружия ИИ, как это сделал Женевский протокол в отношении химического оружия после Первой мировой войны. «Что-то вроде Женевской конвенции было бы замечательно, но такие конвенции никогда не принимаются до тех пор, пока они не будут использованы», — сказал Хинтон. Какие бы решения ни приняли правительства в отношении ИИ, Хинтон считает, что люди должны осознавать угрозу, которую представляет создаваемая ими техника. «Я думаю, важно, чтобы люди понимали, что это не просто научная фантастика, не просто нагнетание страха, — сказал Хинтон. — Это реальный риск, о котором мы должны думать, и мы должны заранее решить, как с ним справиться». Vk Telegram Facebook Twittern Od Email Поддержите нас! Каждый день наш проект старается радовать вас качественным и интересным контентом. Поддержите нас любой суммой денег удобным вам способом! Поддержать

ИИ теперь способен рассуждать

Военные роботы дестабилизируют мир

«Крёстный отец ИИ» говорит: ИИ способен к разуму, но может стремиться к контролю

ПОХОЖИЕ НОВОСТИ